OpenAI最近发布了他们的新一代embedding模型,称为embeddingv3,他们描述是他们性能最好的embedding模型,具有更高的多语言性能。这些模型分为两类:较小的称为text-embeddings-3-small,较大且功能更强大的称为text-embeddings-3-large。

有关这些模型的设计和训练方式的信息披露得很少。正如他们之前发布的embedding模型(2022年12月与ada-002模型类)一样,OpenAI再次选择了一种闭源方法,其中模型只能通过付费API访问。

但这些性能真的值得花钱去看吗?

这篇文章的动机是将这些新模型与开源模型的性能进行实证比较。我们将依赖于一个数据检索工作流,在这个工作流中,必须根据用户查询找到语料库中最相关的文档。

我们的语料库将是欧洲人工智能法案,该法案目前处于验证的最后阶段。这个语料库除了是世界上第一个关于人工智能的法律框架外,还有一个有趣的特点,那就是它有24种语言版本。这使得比较不同语言族的数据检索的准确性成为可能。

这篇文章将通过以下两个主要步骤:

- 从多语言文本语料库生成自定义合成问题/答案数据集

- 在此自定义数据集上比较OpenAI和最先进的开源embedding模型的准确性。 重现本文中呈现的结果的代码和数据可以在这个Github存储库中获得。请注意,本文以欧盟人工智能法案为例,本文所采用的方法可以适用于其他数据语料库。

生成自定义Q/A数据集

让我们首先从生成自定义数据的问答(Q/ a)数据集开始,该数据集将用于评估不同embedding模型的性能。生成自定义Q/ a数据集的好处是双重的。首先,它通过确保数据集没有成为embedding模型训练的一部分来避免偏差,这可能发生在参考基准上,如MTEB。其次,它允许将评估调整为特定的数据语料库,这可能与检索增强应用程序(RAG)等情况相关。

我们将遵循LlamaIndex在他们的文档中建议的简单流程。语料库首先被分成一组块。然后,对于每个分块,通过大型语言模型(large language model, LLM)生成一组合成问题,使答案位于相应的分块中。这个过程说明如下:

为您的数据生成问题/答案数据集,方法来自LlamaIndex

使用Llama Index之类的LLM数据框架实现此策略非常简单。可以使用高级函数方便地加载语料库和分割文本,如下面的代码所示。

1 | from llama_index.readers.web import SimpleWebPageReader |

在这个例子中,语料库是欧盟人工智能法案的英文版本,直接取自Web,使用这个官方URL。我们使用2021年4月的草案版本,因为最终版本尚未适用于所有欧洲语言。在这个版本中,可以用其他23种欧盟官方语言中的任何一种语言替换URL中的英语,以检索不同语言的文本(BG表示保加利亚语,ES表示西班牙语,CS表示捷克语,等等)。

下载欧盟24种官方语言的欧盟人工智能法案链接(来自欧盟官方网站)

我们使用SentenceSplitter对象将文档分成每1000个令牌的块。对于英语来说,这导致大约100个块。

然后将每个块作为上下文提供给以下提示符(Llama Index库中建议的默认提示符):

1 | prompts={} |

提示旨在生成关于文档块的问题,就好像老师正在准备即将到来的测验一样。要为每个数据块生成的问题数量作为参数num_questions_per_chunk传递,我们将其设置为2。然后可以通过调用LlamaIndex库中的generate_qa_embedding_pairs来生成问题:

1 | from llama_index.llms import OpenAI |

我们依靠OpenAI的GPT-3.5-turbo-0125模式来完成这项任务,该模式是OpenAI该系列的旗舰模型,支持16K上下文窗口并针对对话进行了优化(https://platform.openai.com/docs/models/gpt-3-5-turbo。

结果对象’ qa_dataset ‘包含问题和答案(块)对。作为生成问题的示例,以下是前两个问题的结果(其中“答案”是文本的第一部分):

- 根据解释性备忘录,制定人工智能协调规则(人工智能法案)的法规提案的主要目标是什么?

- 如上下文信息所述,人工智能法规提案如何旨在解决与使用人工智能相关的风险,同时促进欧盟对人工智能的采用?

Chunks和问题的数量取决于语言,英语大约有100个chunks和200个问题,匈牙利语有200个chunks和400个问题。

OpenAI embedding模型的评价

我们的评估函数遵循LlamaIndex文档,由两个主要步骤组成。首先,所有答案(文档chunks)的嵌入都存储在VectorStoreIndex中,以便有效检索。然后,评估函数循环遍历所有查询,检索前k个最相似的文档,并根据MRR评估检索的准确性(Mean Reciprocal Rank)。

1 | def evaluate(dataset, embed_model, insert_batch_size=1000, top_k=5): |

Embedding模型通过embed_model参数传递给评估函数,对于OpenAI模型,该参数是一个用模型名称和模型维度初始化的OpenAI Embedding对象。

1 | from llama_index.embeddings.openai import OpenAIEmbedding |

dimensions API参数可以缩短嵌入(即从序列的末尾删除一些数字),而不会失去embedding的概念表示属性。例如,OpenAI建议在他们的公告中,在MTEB基准测试中,embedding可以缩短到256的大小,同时仍然优于未缩短的1536大小的text-embedt-ada-002embedding。

我们在四种不同的OpenAIembedding模型上运行评估函数:

- 两个版本的

text-embeddings-3-large:一个具有最低可能维度(256),另一个具有最高可能维度(3072)。它们被称为OAI-large-256和OAI-large-3072。 - OAI-small:

text-embedding-3-smallembedding模型,维度为1536。 - OAI-ada-002:传统的

text-embedding-ada-002模型,维度为1536。

每个模型在四种不同的语言上进行评估:英语(EN),法语(FR),捷克语(CS)和匈牙利语(HU),分别涵盖日耳曼语,罗曼语,斯拉夫语和乌拉尔语的例子。

1 | embeddings_model_spec = { |

所得的MRR精度报告如下:

OpenAI模型的性能总结

正如预期的那样,对于大型模型,embedding尺寸3072越大,性能越好。与小型和遗留的Ada模型相比,大型模型比我们预期的要小。为了比较,我们还在下面报告了OpenAI模型在MTEB基准测试上获得的性能。

OpenAI embedding模型的性能,详见官方公告

有趣的是,与MTEB基准测试相比,大型、小型和Ada模型之间的性能差异在我们的评估中远没有那么明显,这反映了这样一个事实,即在大型基准测试中观察到的平均性能不一定反映在定制数据集上获得的性能。

开源embedding模型的评估

围绕嵌入的开源研究相当活跃,并且定期发布新的模型。了解最新发布的模型的一个好地方是hug Face..MTEB排行榜。

为了在本文中进行比较,我们选择了最近发表的(2024)四个embedding模型。选择的标准是他们在MTEB排行榜上的平均得分和他们处理多语言数据的能力。所选模型的主要特性摘要如下。

| Embedding model | Embedding size | Context sizeS | ize (GB) | MTEB Rank (Feb 24) | Release date | |

|---|---|---|---|---|---|---|

| e5-mistral-7b-instruct | 4096 | 32768 | 14 | 4 | 04/01/2024 | |

| multilingual-e5-large-instruct | 1024 | 514 | 1.12 | 10 | 08/02/2024 | |

| BGE-M3 | 1024 | 8192 | 2.27 | NA | 29/01/2024 | |

| nomic-embed-text-v1 | 768 | 8192 | 0.55 | 22 | 10/02/2024 |

选择开源embedding模型

- *E5- mistral-7b- instruction * (E5-mistral-7b):微软的E5embedding模型是从Mistral-7B-v0.1初始化的,并在多语言数据集的混合上进行微调。该型号在MTEB排行榜上表现最好,但也是迄今为止最大的(14GB)。

- *multilingual- E5-large - directive * (ML-E5-large):微软的另一个E5模型,旨在更好地处理多语言数据。它从xlm-roberta-large初始化,并在多语言数据集的混合上进行训练。它比E5-Mistral小得多(10倍),但上下文大小也小得多(514)。

- *BGE-M3*:该模型由北京人工智能研究院设计,是他们最先进的多语言数据embedding模型,支持100多种工作语言。截至2024年2月22日,它还没有进入MTEB排行榜。

- *** Nomic- embed-text-v1*** (Nomic- embed):该模型由Nomic设计,声称性能优于OpenAI Ada-002和text- embeding3 -small,而大小仅为0.55GB。有趣的是,该模型是第一个完全可复制和可审计的(开放数据和开源训练代码)。

用于评估这些开源模型的代码类似于用于OpenAI模型的代码。主要的变化在于模型规范,其中必须指定诸如最大上下文长度和池类型之类的附加细节。然后,我们对四种语言中的每一种模型进行评估:

1 | embeddings_model_spec = { |

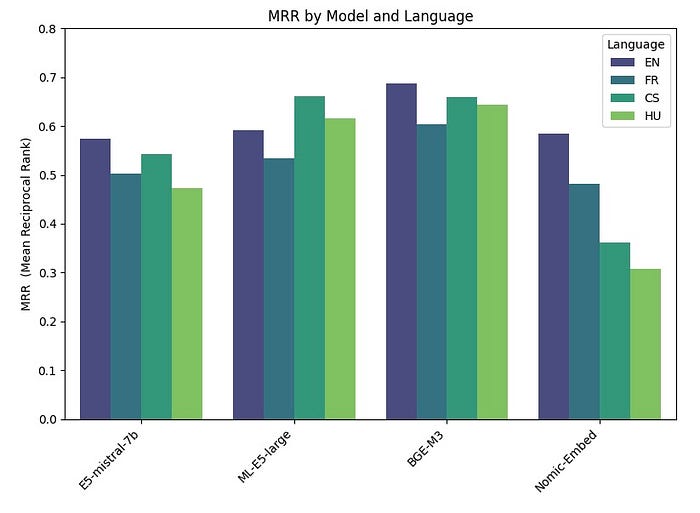

以MRR表示的结果准确性报告如下。

开源模型的性能总结

BGE-M3的性能最好,其次是ML-E5-Large、E5-mistral-7b和Nomic-Embed。BGE-M3模型尚未在MTEB排行榜上进行基准测试,我们的结果表明它可能比其他模型排名更高。值得注意的是,虽然BGE-M3针对多语言数据进行了优化,但它在英语方面的表现也比其他模型更好。

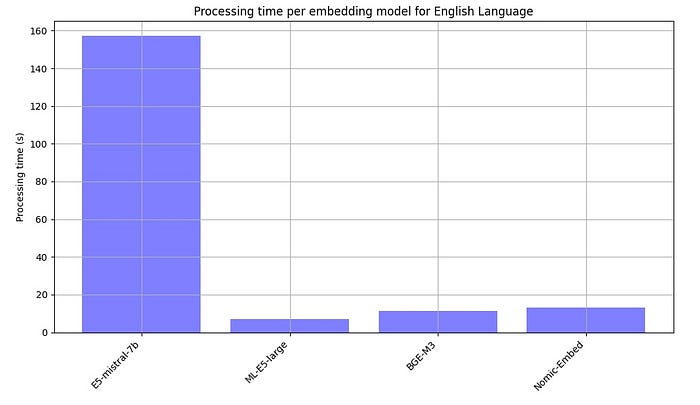

我们还在下面报告了每个embedding模型的处理时间。

以秒为单位浏览英文问答数据集的处理时间

E5-mistral-7b比其他型号大10倍以上,毫无疑问是迄今为止最慢的型号。

结论

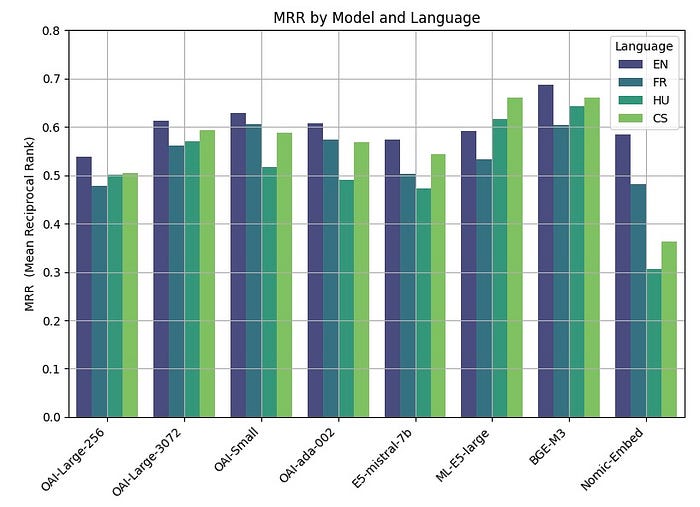

让我们把八个测试型号的性能并排放在一个数字中。

八个测试模型的性能总结

这些结果的主要观察结果是:

- 采用开源模型获得最佳性能。由北京人工智能研究院开发的BGE-M3模型成为表现最好的模型。该模型具有与OpenAI模型相同的上下文长度(8K),大小为2.2GB。

- OpenAI范围内的一致性。大型(3072)、小型和传统OpenAI模型的性能非常相似。然而,减少大型模型(256)的embedding大小会导致性能的下降。

- 语言敏感性。几乎所有型号(ML-E5-large除外)在英语上表现最好。在捷克语和匈牙利语等语言中,人们的性能存在显著差异。

因此,你是应该付费订阅OpenAI,还是托管一个开源embedding模型?

OpenAI最近的价格调整使得他们的API变得更加实惠,现在每百万代币的成本为0.13美元。因此,每月处理一百万个查询(假设每个查询涉及大约1K令牌)的成本约为130美元。因此,根据您的用例,租用和维护您自己的embedding服务器可能不符合成本效益。

然而,成本效益并不是唯一的考虑因素。可能还需要考虑延迟、隐私和对数据处理工作流的控制等其他因素。开源模型提供了完全数据控制的优势,增强了隐私性和定制性。另一方面,OpenAI的API也存在延迟问题,有时会导致响应时间延长。

总之,在开源模型和像OpenAI这样的专有解决方案之间做出选择并不是一个简单的答案。开源嵌入提供了一个引人注目的选择,它将性能与对数据的更好控制结合在一起。相反,OpenAI的产品可能仍然会吸引那些优先考虑便利性的人,特别是如果隐私问题是次要的。

引用

- Companion Github repository: https://github.com/Yannael/multilingual-embeddings

- Everything you wanted to know about sentence embeddings (and maybe a bit more)

- OpenAI blog announcement: New embedding models and API updates

- Embeddings: OpenAI guide

- MTEB: Massive Text Embedding Benchmark and Hugging Face MTEB leaderboard

- Text Embeddings: Comprehensive Guide

- A Practitioners Guide to Retrieval Augmented Generation (RAG)

- How to Find the Best Multilingual Embedding Model for Your RAG

原文:https://towardsdatascience.com/openai-vs-open-source-multilingual-embedding-models-e5ccb7c90f05