通过直观的拖放界面简化LangChain流程开发

在之前的一篇博客文章《LangFlow–可视化的LangChain》中,我们探讨了LangFlow的功能以及如何利用其直观的无代码界面。

今天,我很高兴地分享另一个类似的工具,它提供了一个无代码的拖放开发体验:Flowise。

Flowise为开发人员提供了一个特殊的工具,旨在构建LLM应用程序,而无需深入研究编码。对于努力以敏捷方式快速构建原型并开发LLM应用程序的组织来说,这同样是有益的。让我们来看看Flowise AI的一些突出功能:

拖放式UI: Flowise使设计自己的自定义LLM流程变得简单。

开源: 作为一个开源项目,Flowise可以自由使用和修改。

用户友好: Flowise很容易上手,即使对那些没有编码经验的人也是如此。

通用: Flowise AI可用于创建各种LLM应用程序。

安装和设置

要安装和开始使用Flowise,请遵循以下步骤:

- 下载和安装 NodeJS >= 18.15.0 (使用node -v 查一下你安装的版本,如果不够高,那么我建议你直接在这个页面解决问题:https://nodejs.org/en/download)

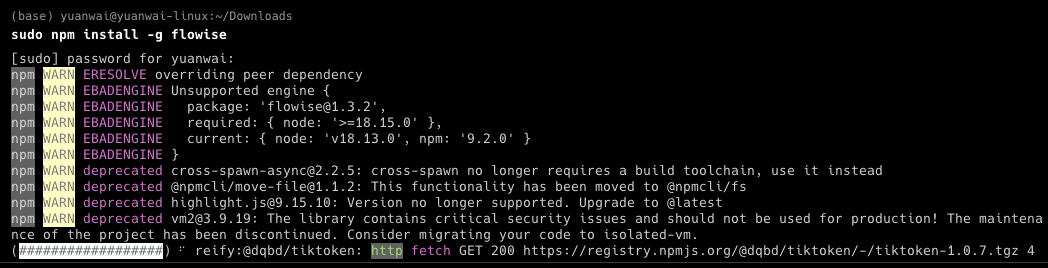

- 使用以下命令安装Flowise:

1 | npm install -g flowise |

译者:这里比较啰嗦的可能就是各种版本问题了,如nodejs、npm等等。

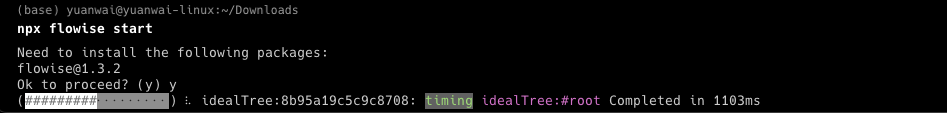

- 启动Flowise

1 | npx flowise start |

译者:系统会要求你再安装flowise@1.x.x,安装就好了,还是那句话,如果不是root,别忘了sudo。

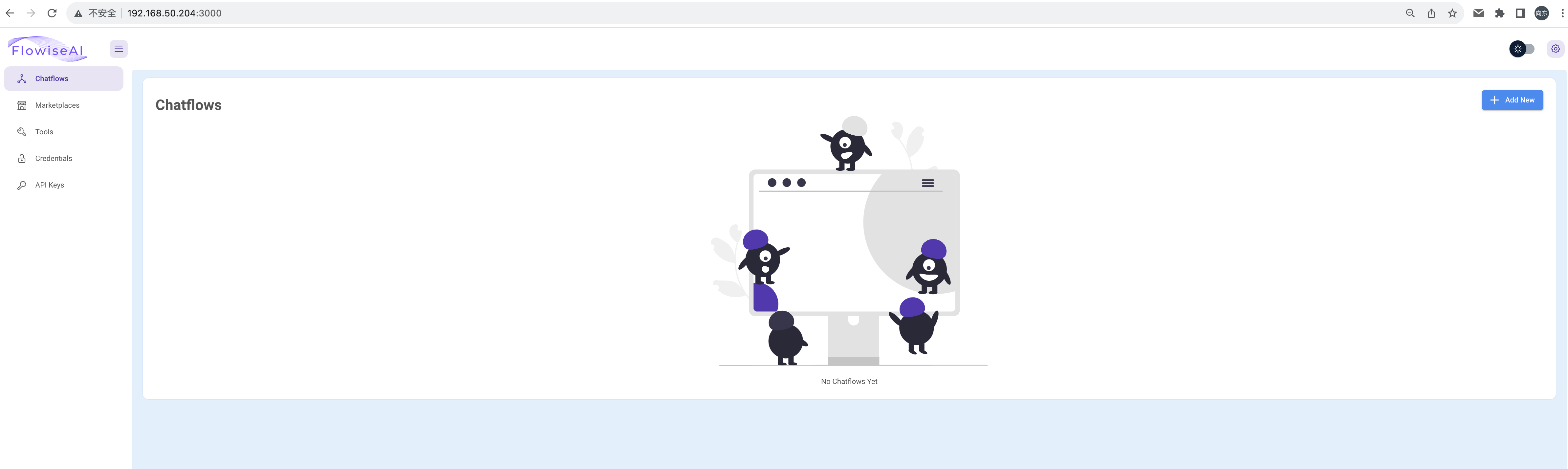

在浏览器上打开 http://localhost:3000

译者:我部署在家里的ubuntu上,所以地址会不一样。

现在您应该看到网站启动了。

接下来,我们将使用Flowise构建两个应用程序,这两个应用程序都不需要编码。

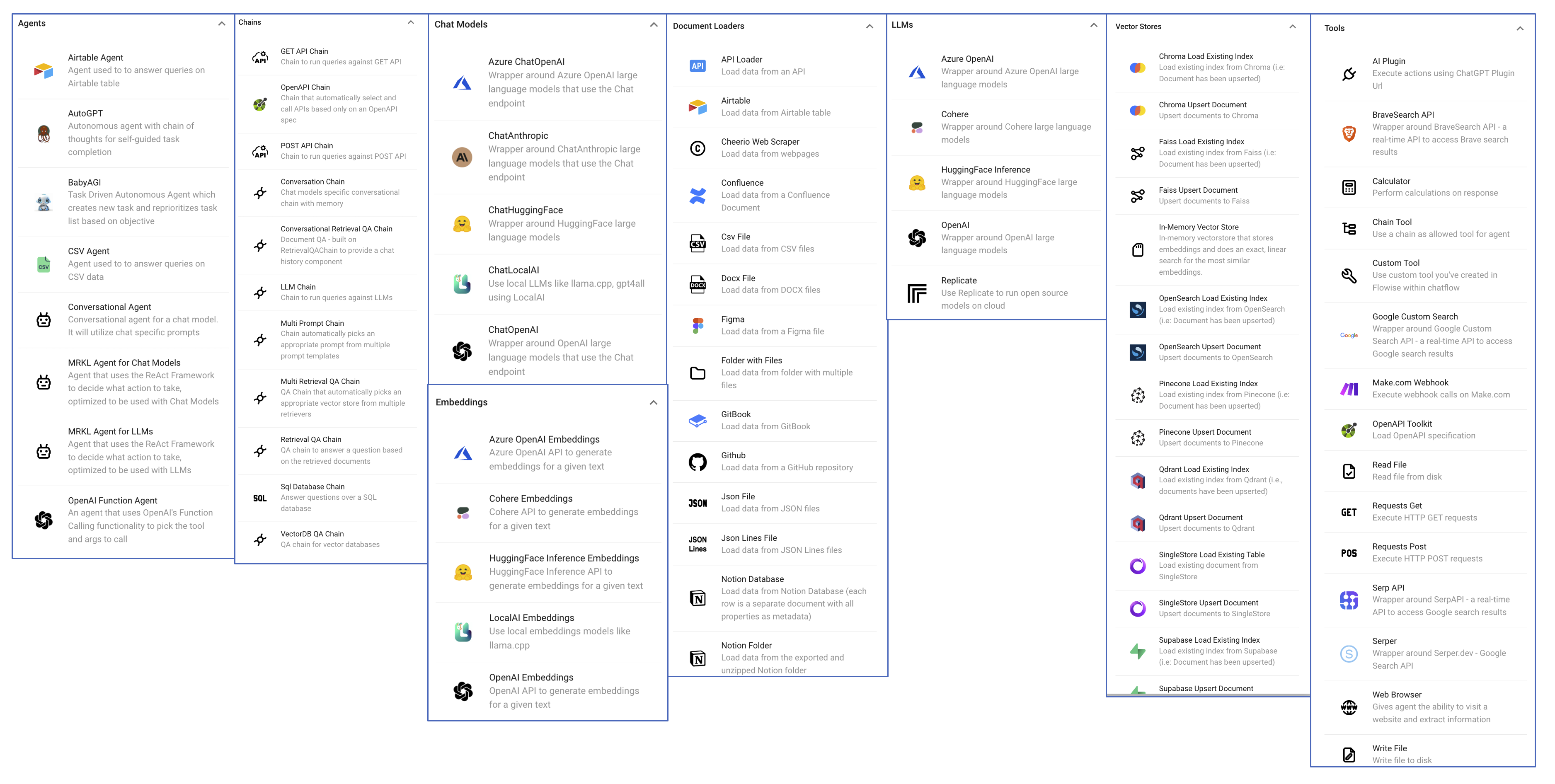

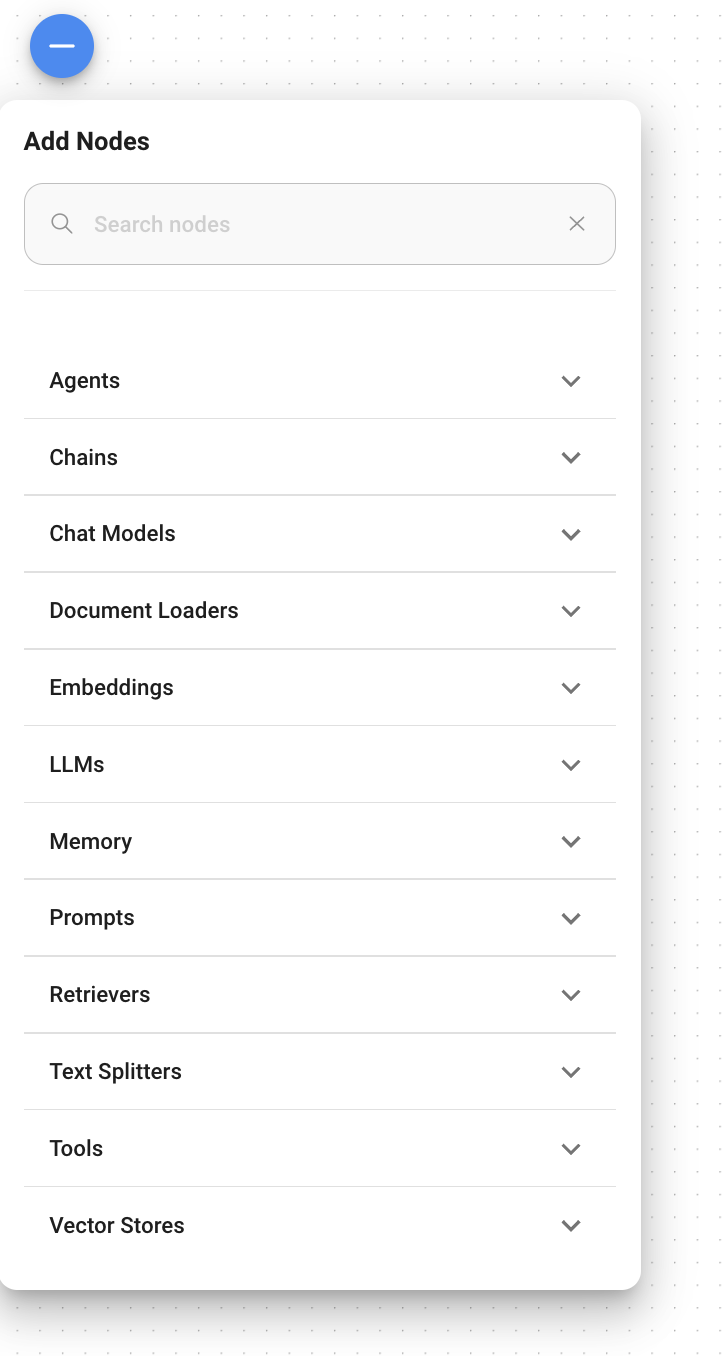

我们开看看丰富的组件,丰富程度让我有点吃惊,包括notion也都有。

示例1:构建基本LLM链

遵循以下步骤:

- 在空白画布上,单击”+ Add New”按钮以调出左侧的”Add Nodes”面板。

- 从“Add Nodes”面板中选择以下组件,它们将出现在画布上。

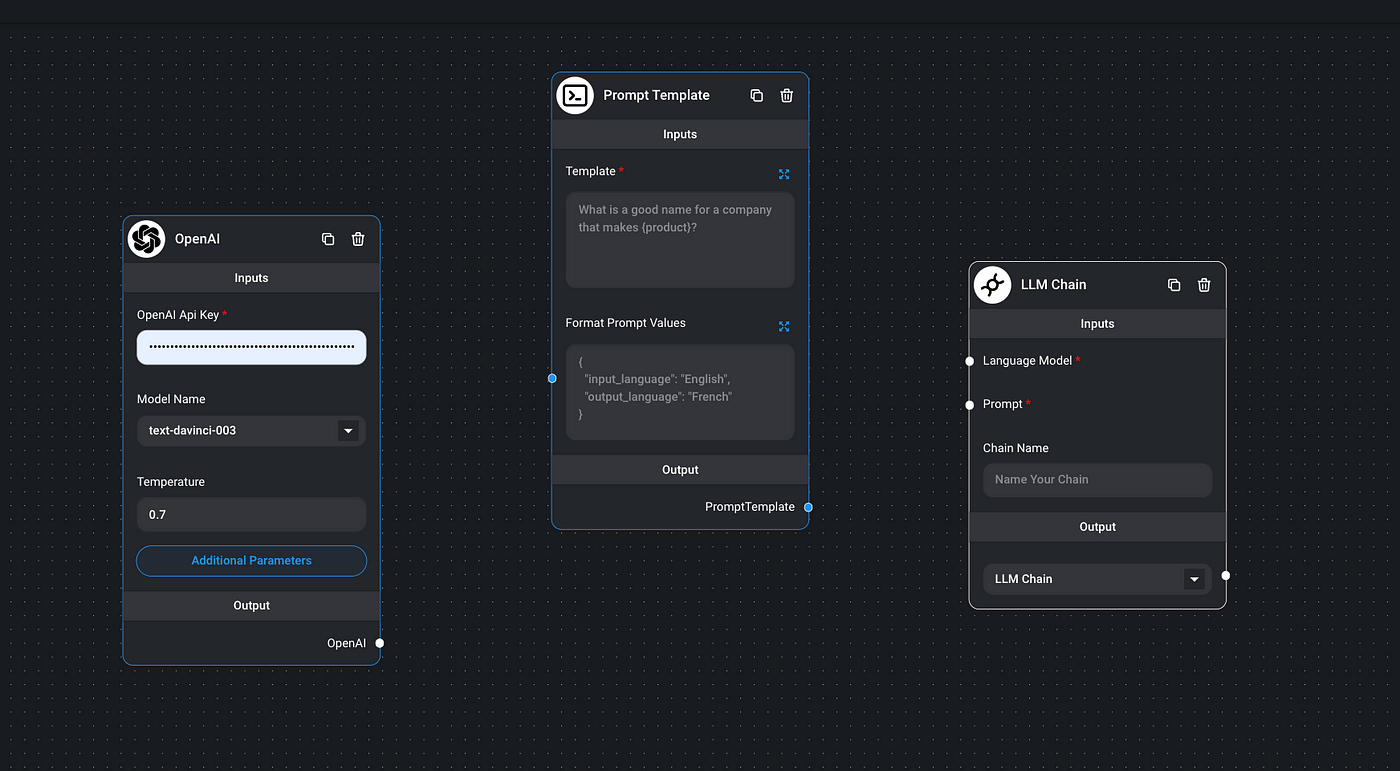

- 从LLMs中将OpenAI拖到面板

- 从Chains分类中拖出LLM chain

- 从Promps分类中拖出Prompt Template

现在,画布应该是这样的:

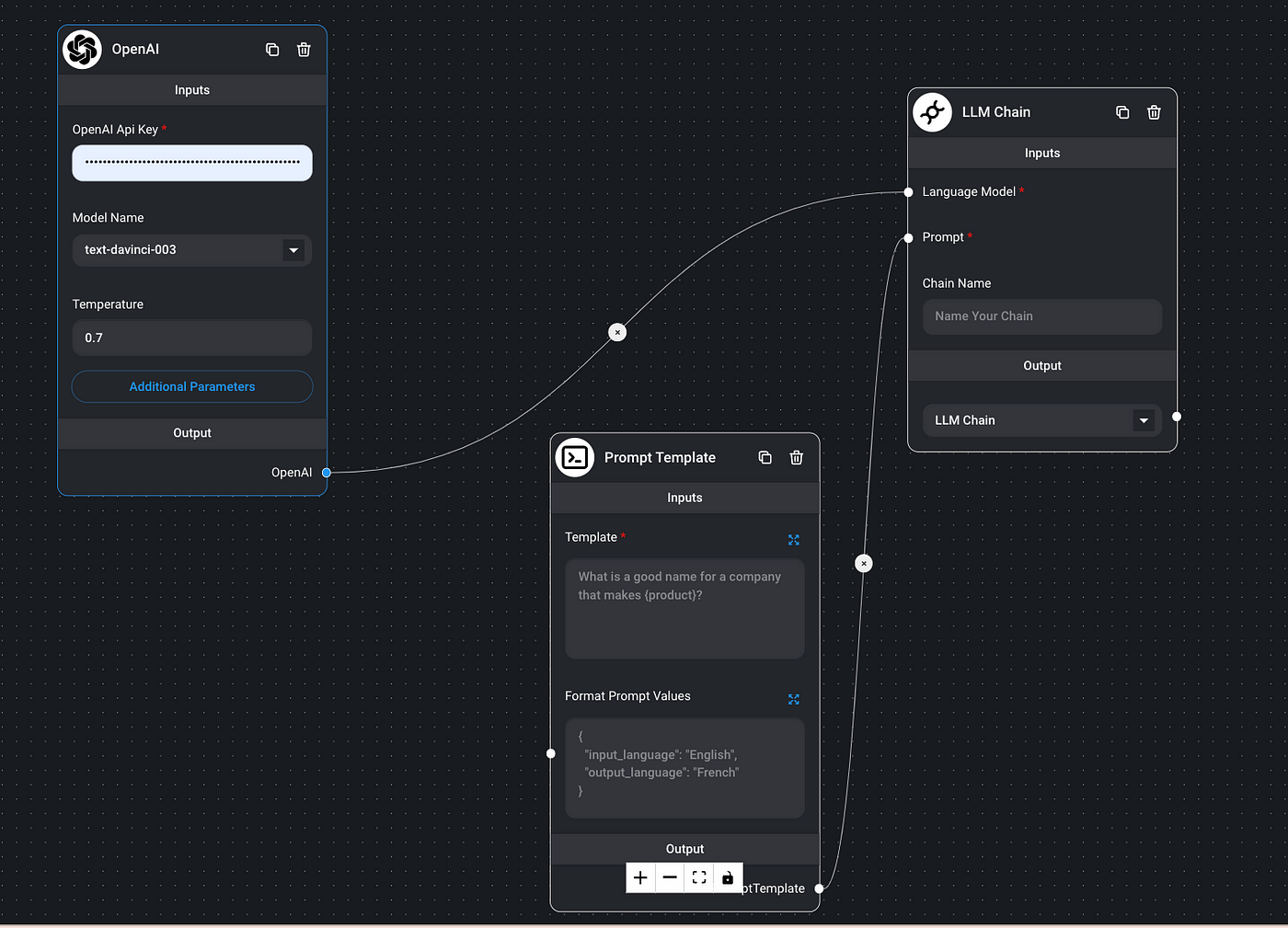

- 连接组件

- 将OpenAI的输出(output)链接到LLM Chain的语言模型(input)

- 将Prompt Template的输出(output)链接到LLM Chain的Prompt(input)

- 输入必要的信息

- 在OpenAI的字段中输入OpenAI密钥

- 将以下prompt模板写入“Prompt Template”的Template字段中:

What is a good name for a company that makes {product }?

- 给LLM Chain一个名字.

- 单击右上角的“保存”图标进行保存.

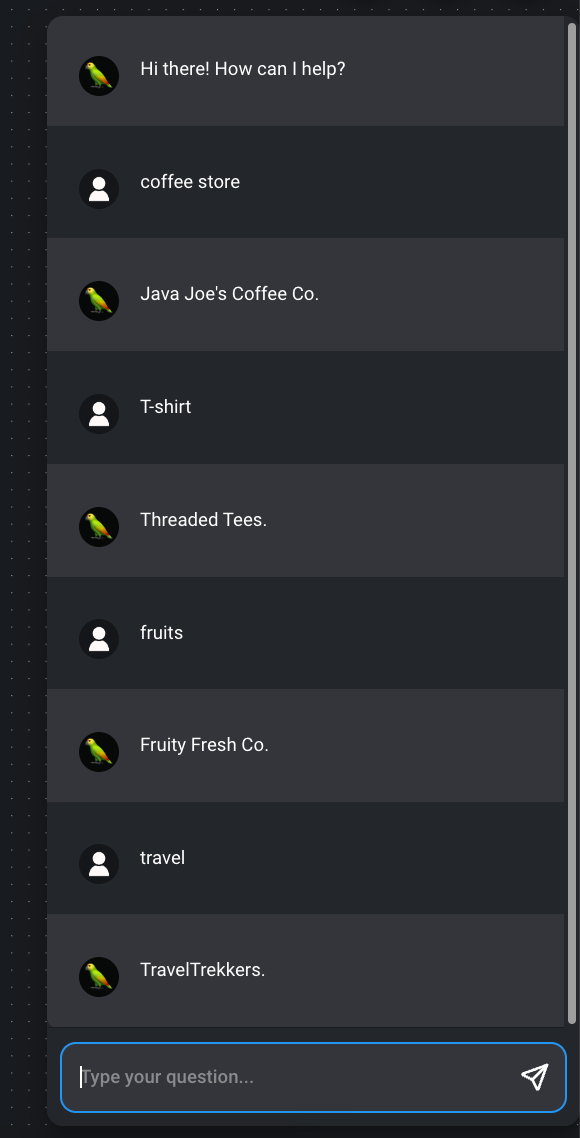

- 点击右上角的聊天图标,就可以开始发送“产品名称”了。在这里,我们得到了预期的答案.

示例2:构建PDF阅读器Bot

在之前的一篇博文中,我演示了如何使用LangFlow创建PDF Reader Bot。现在,让我们使用Flowise创建相同的机器人。

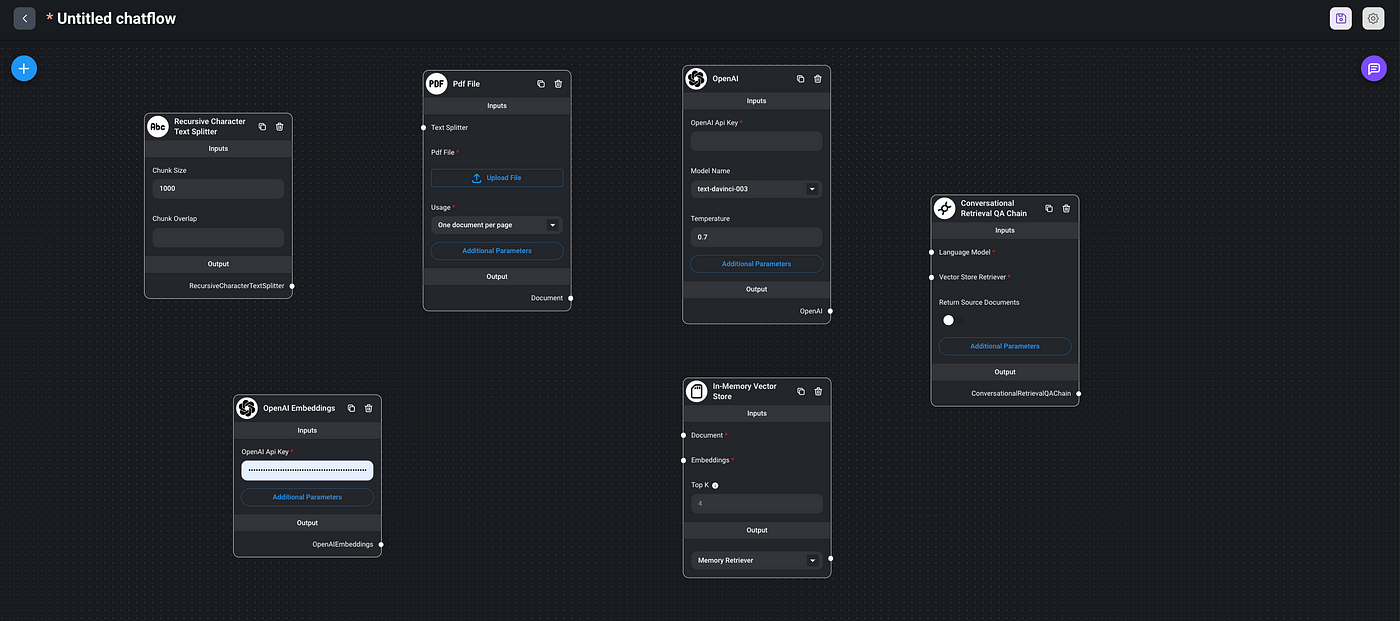

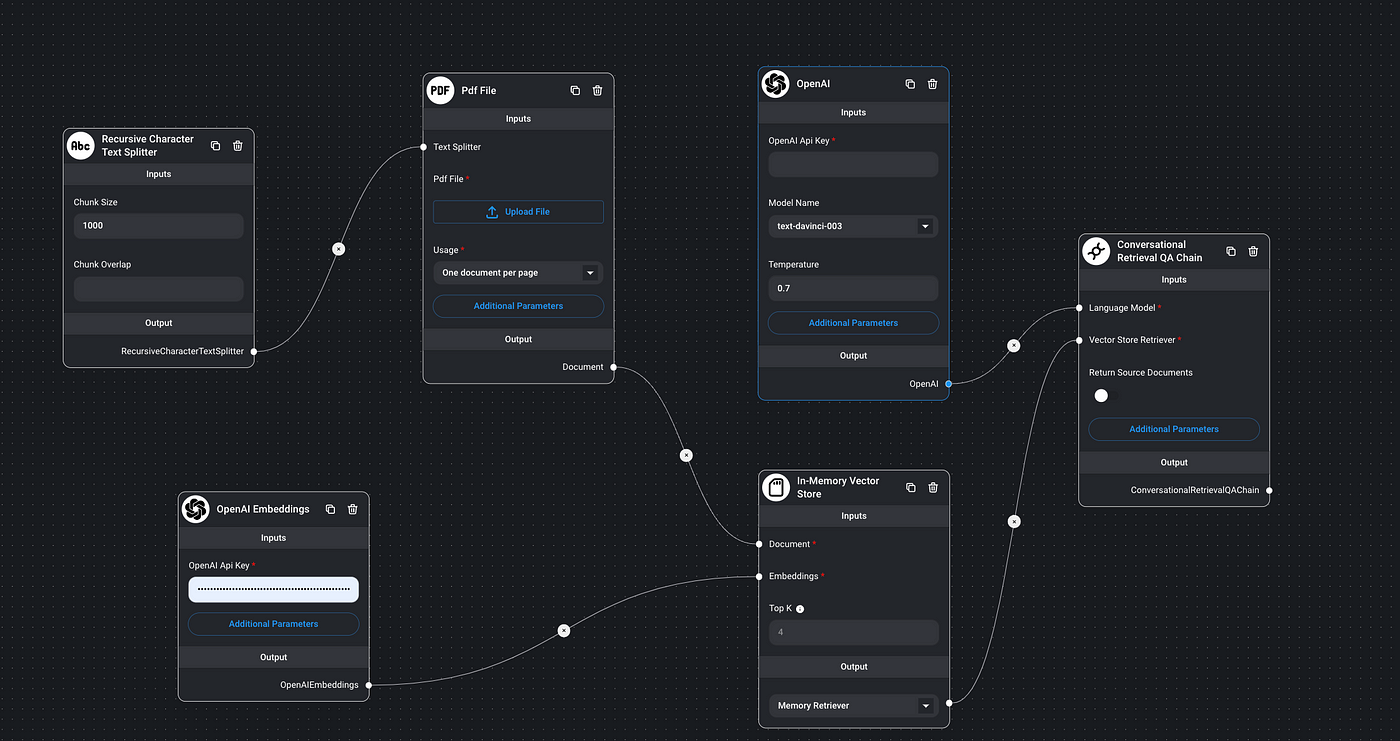

- 将以下组件添加到空白画布中:

- 从“Text Splitters”中选择“Recursive Character Text Splitter”(递归字符文本分割器)

- 从“Document Loaders”中选择“PDF file”

- 从“Embeddings”中选择“OpenAI Embeddings”

- 从“Vector Stores”中选择“In-memory Vector Store”(内存向量存储)

- 从“LLMs”中选择“OpenAI”

- 从“Chains”中选择“Conversational Retrieval QA Chain”(对话检索QA Chain)

现在我们在画布中拥有了所有必需的组件。

- 连接组件

- 链接“Recursive Character Text Splitter” 的输出和 “PDF file” 的输入

- 链接“PDF file” 的输出和 “In-memory Vector Store”的输入

- 链接“OpenAI Embeddings” 的输出和“In-memory Vector Store” 的输入

- 链接“In-memory Vector Store” 的输出和 “Conversational Retrieval QA Chain”的输入

- 链接“OpenAI” 的输出和 “Conversational Retrieval QA Chain” 的输入

- 输入必要的信息

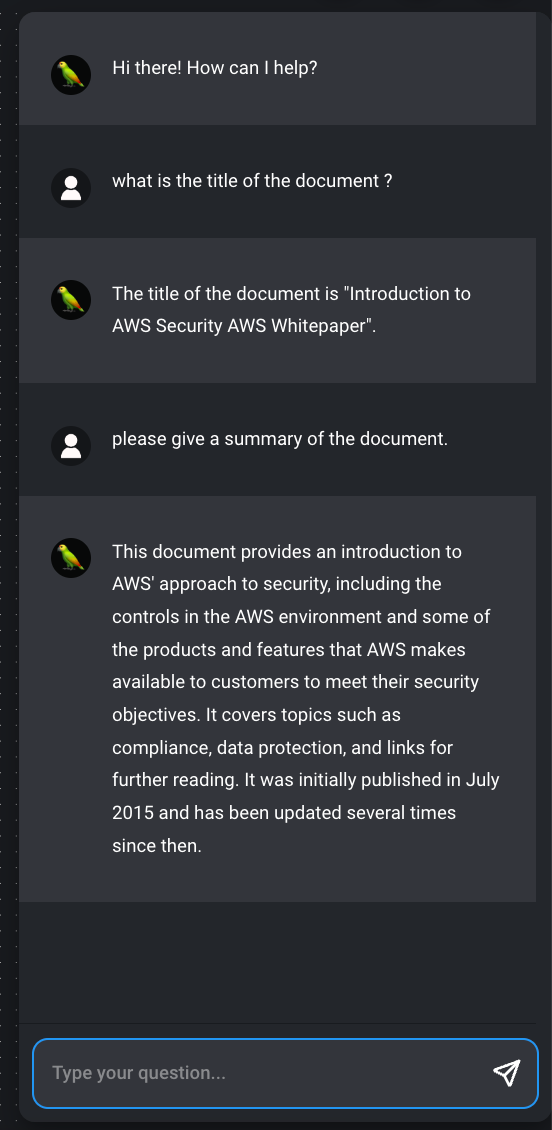

- 点击“PDF File”中的“Upload File”,上传标题为“Introduction to AWS Security”的示例PDF文件。

- 在“OpenAI”和“OpenAIEmbeddings”字段中输入您的OpenAI密钥

- 单击“save”按钮,然后单击聊天按钮开始发送请求。

响应应该如预期的那样,并且机器人现在可以回答与此pdf文档相关的任何问题。

总之,这篇博客介绍了Flowise,一个用户友好的、无代码的平台,它简化了构建LangChain工作流的过程。Flowise是一个开源工具,允许开发人员和组织创建LLM应用程序,而无需编写代码。该博客引导读者完成Flowise的安装和设置过程,并就如何构建两种类型的应用程序提供分步说明:基本的LLM链和PDF阅读器Bot。Flowise的关键特性,包括拖放式UI、用户友好性和多功能性,都得到了强调。

对了,Flowise的Github Repository。

后续再研究一下和ChatGLM、百川、通义等如何对接。

原文:Flowise: An Agile Way of LLM Application Development With No-Code Solution